Александр Розов. Продолжаем тему ИИ: создание модели попугая со все большим запасом типовых фраз

Ниже приводятся два информационных блока, указывающие на одно и то же: на то, что гонка за ИИ полностью утратила характер научно-прикладного исследования, и превратилась в экстенсивную набивку баз данных — элементами типовых ответов на типовые вопросы с механизмом корректировки весов этих элементов в ходе обучения.ш

Проще говоря: ИИ-индустрия плюнула на суть дела и занялась созданием модели попугая со все большим запасом типовых фраз.

ИСКУССТВЕННЫЙ ИНТЕЛЛЕКТ. Доклад «2023 AI Index», составленный специалистами Стэнфордского университета, Google, Anthropic и Hugging Face, свидетельствует о том, что сфера ИИ входит в новую фазу развития. За последний год большое количество инструментов ИИ получили широкое применение — от чатботов вроде ChatGPT до генераторов изображений вроде Midjourney. Но решения о том, как использовать эту технологию, уравновешивать риски и возможности принимают в первую очередь корпорации — они оттеснили академические научные лаборатории и правительства в разработках и внедрении приложений с ИИ.

Авторы отчета утверждают, что многие годы академические круги лидировали в разработке передовых систем ИИ, но теперь вырвалась вперед цифровые корпорации и промышленность. В 2022 году было создано 32 значимых промышленных модели машинного обучения, а научными центрами — всего три. В основном это происходит из-за того, что технология ИИ стала требовать все больше ресурсов — данных, персонала, вычислительных мощностей — необходимых для создания таких приложений. И те, у кого меньше таких ресурсов, становятся аутсайдерами новой технологической гонки.

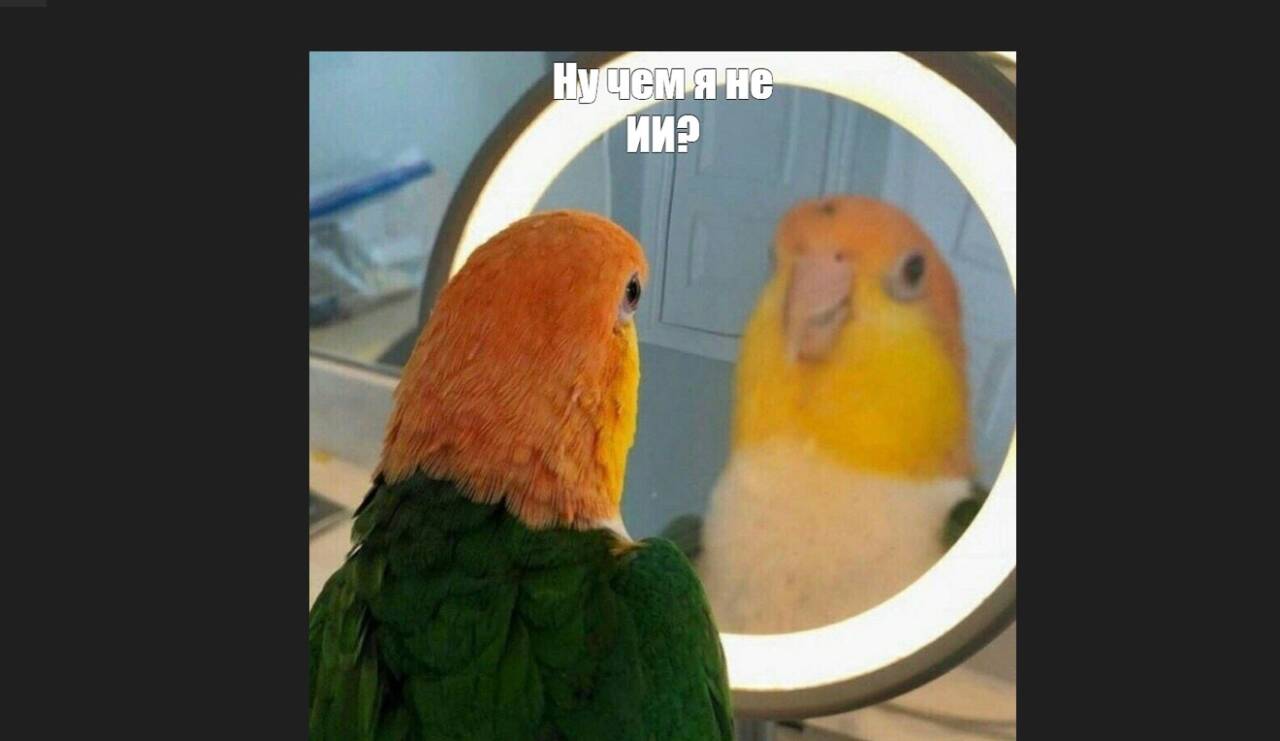

В 2019 году OpenAI создала GPT-2, языковую модель, которая тогда стоила компании приблизительно $50 000 и обладала 1,5 млрд параметров. В 2022 году Google создает собственную модель PaLM за $8 млн и с 540 млрд параметров. Это в 360 раз больше, чем было у GPT-2, и в 160 раз дороже.

Анализ ситуации в 127 странах показал, что количество принятых законов, содержащих словосочетание «искусственный интеллект» вырос с одного в 2016 году до 37 в 2022-м.

К другим важным тенденциям можно отнести:

Впервые за десятилетие снизились частные инвестиции в ИИ.

Обучение крупных моделей ИИ приводит к значительной нагрузке на окружающую среду.

Жители Китая относятся к ИИ более оптимистично, чем американцы.

3 апреля Александр Березин. Контроль над демонами: почему Маск и Возняк требуют остановить развитие ChatGPT

..не исключено, что все это письмо — типичная ошибка, порожденная чрезмерно узкой специализацией его авторов. Начнем с главного: искусственного интеллекта не существует. Как совершенно верно отметила в 2021 году работавшая для Microsoft Кэйт Кроуфорд: «ИИ — это не искусственный, и не интеллект». Она развивает свою мысль: «С самого начала разработчики ИИ… мы сделали ужасную ошибку: поверили, что сознания — как компьютеры, и компьютеры — как сознание. Мы предположили, что эти штуки — аналог человеческого разума, но ничто не может быть дальше от истины».

Здесь стоит понять, почему. Представим, что есть нечто, что безусловно существует, но чью суть мы не понимаем — хотя пытаемся, потому что это явно мощная штука. Сделать это легко: например, в 1908 году над Сибирью рванул взрыв на десятки мегатонн, убивший троих человек. Вопрос: могли ли люди 1908 года воспроизвести его в том же году?

Ответ довольно прост: пока они не узнали, что это было и как научиться делать взрывы той же мощности, нет, не могли. На данный момент у ученых и философов нет никакого понимания, что такое естественный разум (интеллект), и даже определения, на котором бы большинство ученых сошлись. Почему?

Приведем пример такого определения: «разум (интеллект) — это способность воспринимать информацию или делать выводы из нее и запоминать ее как знание, которое можно применить в отношении адаптивного поведения в той или иной среде».

Любой биолог в этот момент рассмеется: получается, даже слизевик физарум многоглавый разумен. Еще 15 лет назад в эксперименте было показано, что он способен именно на то, что написано в цитате выше.

Только вот есть проблема: у слизевика вообще нет мозгов. И нервных клеток тоже нет.

Как именно без нервной системы удается использовать информацию для адаптации, неизвестно. Но совершенно точно так же неизвестно, как это делаем мы.

Определений интеллекта было выдумано множество — более сотни. Однако все попытки применить их к реальности заканчивались таким же фиаско, что мы описали выше: «интеллект», выходит, был даже у растений, а то и у вовсе у природных процессов.

Однажды исследователи попробовали создать определение интеллекта, которое устроило бы всех. Правда, «всех» опять не вышло: под ним подписалось только 52 специалиста из 131 (то есть меньшинство), участвовавшего в выработке определения. Большинство отказались по очень простой причине: чтобы его нельзя было «натянуть» на деревья и прочую плесень, определение сделали максимально общим.

Оно прямо начиналось словами «Очень общая ментальная способность…» — и продолжалась примерно так же расплывчато. Пользы от него тоже нет: если в определении нет конкретики, а разум «определяется» как способность к абстрактному мышлению (при отсутствии определения термина «мышления»).

ChatGPT — это большая языковая модель, натренированная на огромной выборке из массивов слов. Представим, что вы залили в некую базу данных все книги, написанные человечеством, плюс все, написанное людьми в интернете. Разбили (людьми ли, нейросетью-классификатором ли, неважно) залитое на небольшие тематические блоки, каждый из которых можно рассматривать как кусочек ответа на вопрос. Затем задали определенные правила — назовем их «четыре арифметических правила для чат-бота», — по которым эти тематические блоки можно смешивать.

Именно этим и пользуются многие хитрые хомо сапиенсы. Кто-то «пишет» чат-ботом в соцсети для знакомств с противоположным полом. Ну какая девушка сразу спросит у вас, почему в законах Хаммурапи выбрана такая высокая отсекающая кредитная ставка? Подобных вопросов на свидании можно и за всю жизнь не услышать, зато «ответы» от чат-бота действительно поднимают шанс получить от собеседницы (или собеседника) «да».

Только вот к разуму такие обмены репликами не имеют никакого отношения. Приложение для игры в шахматы на вашем телефоне тоже может рассчитать бесчисленное количество ходов. Но значит ли это, что вы должны опасаться захвата им господства над миром?

Не стоит волноваться, как это делают авторы все того же письма, что машины наполнят «наши каналы распространения информации пропагандой и неправдой». Откройте глаза и оглянитесь: это уже случилось. Откройте газету, которую вы читаете по утрам: с большой долей вероятности она переполнена «пропагандой и неправдой».

Предыдущие обсуждения по теме:

Все надежды человоща. Искусственный интеллект, как бог человощества.

Искусственного интеллекта нет. Но проблема в другом: естественный интеллект гибнет.

Скандальное письмо против развития ИИ. С чего вдруг Маск и Ко стали цифровыми луддитами? Ищем корни

Что сказал Юдковский о людоедском ИИ: huetata around «Pause Giant AI Experiments: An Open Letter»

…Такие дела…

Подпишитесь на наш телеграм-канал https://t.me/history_eco.

Leave a reply

Для отправки комментария вам необходимо авторизоваться.